Next: 類似研究

Up: 日英統計翻訳システム

Previous: デコーダ

目次

デコーダは,言語モデルや翻訳モデルに対して重みを与えることができる.例えば,言語モデルに対して高い重みを与えると,デコーダは言語モデルの確率 を重視した出力を行う.各モデルに与える重みをパラメータと呼ぶ.

このパラメータを最適化するために,MERT(Minimum Error Rate Training)[4]という手法を用いる.

MERTは,後述する自動評価法BLEU[5]のスコアが最大となる翻訳結果を出力するようにパラメータ

を重視した出力を行う.各モデルに与える重みをパラメータと呼ぶ.

このパラメータを最適化するために,MERT(Minimum Error Rate Training)[4]という手法を用いる.

MERTは,後述する自動評価法BLEU[5]のスコアが最大となる翻訳結果を出力するようにパラメータ

の調整を行う.

の調整を行う. 個のパラメータ

個のパラメータ

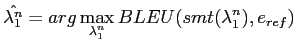

の最適化に用いる式を以下に示す.

の最適化に用いる式を以下に示す.

|

|

|

(26) |

ここで,  はパラメータ

はパラメータ が与えられたときの,デコーダの出力文である.また,

が与えられたときの,デコーダの出力文である.また, はBLEUのスコアであり,デコーダの出力文と,入力文に対してあらかじめ用意された正解文

はBLEUのスコアであり,デコーダの出力文と,入力文に対してあらかじめ用意された正解文 から計算される.

なお,パラメータチューニングにおける入力文として,ディベロップメント文と呼ばれるデータを用いる.

ディベロップメント文を用いて試し翻訳を行い,各文に対して上位N個の翻訳候補を出力する.そしてN個の中から,より自動評価値が高い翻訳候補が上位に来るようにパラメータに

から計算される.

なお,パラメータチューニングにおける入力文として,ディベロップメント文と呼ばれるデータを用いる.

ディベロップメント文を用いて試し翻訳を行い,各文に対して上位N個の翻訳候補を出力する.そしてN個の中から,より自動評価値が高い翻訳候補が上位に来るようにパラメータに

最適化する.試し翻訳とパラメータの調整を繰り返すことで,パラメータチューニングを行う.

最適化する.試し翻訳とパラメータの調整を繰り返すことで,パラメータチューニングを行う.

s122019

2016-03-03